Tenho visto muita gente usando os termos ChatGPT e API da OpenAI de forma intercambiável, como se fossem mesma coisa. Mas não são.

Então vamos entender de uma vez por todas.

A API da OpenAI é um serviço que eles oferecem para que desenvolvedores possam criar seus próprios produtos ou integrar com produtos existentes.

É possível usá-la para criar chatbots, imagens, transcrições de áudio, dentre outras coisas.

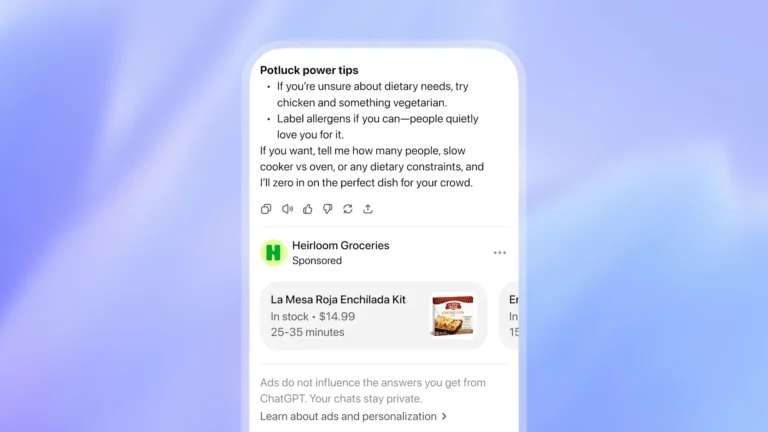

Plataformas como o ChatGPT, Niara, Notion AI e Office 365 utilizam essa API.

Resumindo, a API da OpenAI é um serviço que permite a criação de outros produtos e um desses produtos é o ChatGPT.

Nos termos de uso da OpenAI, ela classifica o ChatGPT como Non-API Content. Já a sua API é classificada como API Content.

Transformers não “guardam memória” como um humano — eles reconstroem contexto a cada requisição

Modelos modernos (como os baseados em Transformers) funcionam, em essência, prevendo a próxima palavra com base no contexto que você fornece. Eles não “lembram” automaticamente do que você disse ontem; eles calculam atenção sobre os tokens presentes na conversa atual e geram a resposta a partir desse recorte. Por isso, a diferença entre “usar ChatGPT” e “usar a API” não é só de produto: é de arquitetura de contexto.

Na API, se você quer continuidade (tom, preferências, histórico, regras, dados do projeto), você precisa enviar esse estado junto (ou reconstruí-lo via uma camada sua), porque o modelo depende do contexto disponível para manter consistência e precisão. E é justamente por isso que o modo como você “carrega memória” (prompt base, histórico, RAG, estado de conversa) vira parte do trabalho de engenharia — não só de redação.

Estado de conversa, persistência e “memória” como componente do seu sistema

Na prática, trabalhar com API costuma exigir que você decida como a memória vai existir:

- memória de curto prazo, que é o histórico recente enviado no próprio request (limitado pela janela de contexto);

- memória de longo prazo, que geralmente é uma base externa (banco/CRM/embeddings/RAG) consultada antes de montar o prompt.

A própria documentação da OpenAI descreve que alguns recursos podem envolver “application state” (estado persistido para cumprir a tarefa), e também detalha controles como o parâmetro store, que determina se uma conversa/resposta pode ficar persistida como estado na plataforma, além de políticas específicas para retenção de logs de abuso.

Privacidade, retenção e governança de dados viram parte do desenho técnico

Essa lógica de “memória como estado” também conversa diretamente com governança. Pela documentação da plataforma, dados enviados à API não são usados para treinar ou melhorar os modelos por padrão (a menos que haja opt-in explícito) e existe retenção de logs de monitoramento de abuso por até 30 dias, com opções como Zero Data Retention ou Modified Abuse Monitoring para casos elegíveis/aprovados.

Já na camada “business” (incluindo API e alguns planos corporativos), a própria OpenAI reforça o compromisso de não treinar por padrão em dados de clientes e descreve retenção e acesso restrito, o que muda como você posiciona risco, compliance e até a forma de orientar o time (ex.: o que pode ou não ir no prompt, quando usar mascaramento, quando usar ZDR, etc.).

Qual a diferença entre Non-API Content e API Content?

Entender essa diferença é CRUCIAL no que diz respeito ao uso de seus dados para treinar os modelos da OpenAI.

Eis o que diz os termos de uso da OpenAI:

We do not use Content that you provide to or receive from our API (“API Content”) to develop or improve our Services. We may use Content from Services other than our API (“Non-API Content”) to help develop and improve our Services.

Non-API Content

Em seus termos de uso, a OpenAI menciona que conteúdos inseridos em serviços Non-API Content, como o ChatGPT, poderão ser usados para ajudar a desenvolver e melhorar seus serviços.

Ou seja, eles poderão ser usados para treinar os modelos.

Caso você não queira que isso aconteça, poderá fazer opt-out através da interface do ChatGPT ou de um formulário online (link disponível nos termos de uso deles).

API Content

Já no caso dos serviços API Content, ocorre exatamente o oposto: por padrão, a OpenAI alega que não usa os dados inseridos nessas APIs para treinar seus modelos.

Segundo a empresa, conteúdos enviados e/ou gerados através da API após 31 de março de 2023, não são usados para treinar seus modelos, a não ser que o usuário (leia-se desenvolvedor) tenha feito opt-in de forma explícita. (Disclaimer: nós, da Niara, não fizemos opt-in).

A única coisa que eles mencionam é que eles retém os dados por até 30 dias para monitorar possíveis abusos. Eu suponho que para, por ex, criação de conteúdo para fake news (opinião própria).

Mas após esse período, eles alegam que os dados são removidos permanentemente.

Bom, espero que ter ajudado a esclarecer suas dúvidas.